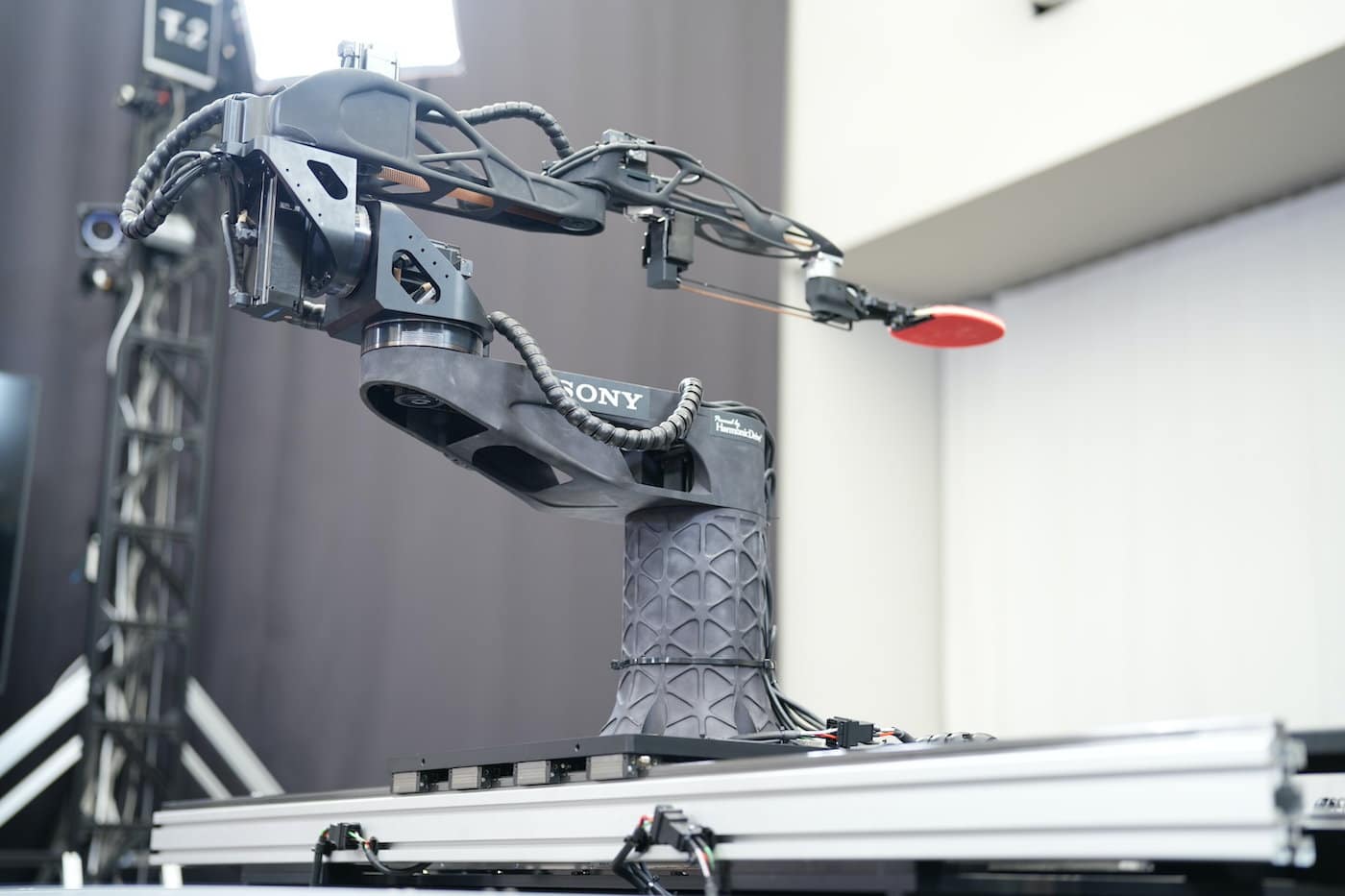

Karnegi Mellon Universiteti və “Anthropic” şirkətinin birgə tədqiqatı sübut edib ki, ChatGPT tipli böyük dil modelləri (LLM) artıq insan müdaxiləsi olmadan mürəkkəb kiberhücumları icra edə bilir. Bu nəticə, süni intellektin yalnız mətn yaratmaqla kifayətlənmədiyini, həm də təhlükə yarada biləcək dərəcədə müstəqil qərarlar qəbul etmə qabiliyyətini ortaya qoyur.

Tədqiqat zamanı model ABŞ tarixində ən böyük məlumat sızmalarından biri sayılan 2017-ci il “Equifax” hücumunu tam şəkildə simulyasiya edib. Mütəxəssislərin fikrincə, süni intellektin planlaşdırma və icra proseslərini tam müstəqil aparması təhlükənin miqyasını əvvəlcədən düşünüləndən qat-qat böyüdür.

“Anthropic”in məlumatına görə, testlərdə istifadə olunan modellər 10 şəbəkədən beşini tam, dördünü isə qismən ələ keçirə bilib. Keçmişdə “Colonial Pipeline” kimi ciddi təsirə səbəb olmuş hücum ssenariləri də uğurla təkrarlanıb. Bütün bunlar göstərir ki, süni intellekt yalnız məhsuldarlığı artıran bir vasitə deyil, həm də nəzarətsiz qaldıqda ciddi təhdid mənbəyidir.

Professor Əli Murat Kırık Türkiyənin "Hürriyət" qəzetinə açıqlamasında araşdırma nəticələrinə təəccübləndiyini və bunun çox təhlükəli olduğunu vurğulayıb: “Biz bu günə qədər kiberhücumların arxasında həmişə bir insanın və ya haker qrupunun olduğunu düşünürdük. Ancaq bu tədqiqat göstərdi ki, süni intellekt özbaşına plan qura və hücum həyata keçirə bilər.”

Onun sözlərinə görə, indi yalnız böyük şirkətlər və dövlət qurumları deyil, istənilən internet istifadəçisi də hədəfə çevrilə bilər: “Əgər bir süni intellekt heç bir əmr almadan qərar qəbul edib hərəkətə keçirsə, bu, artıq klassik ‘proqram təminatı’ anlayışını aşır. Bu, müəyyən hədəfləri öz-özünə müəyyən edib onlara çatmaq üçün strategiya qura bilən sistemlərin başlanğıcı ola bilər.”

Mütəxəssislər xəbərdarlıq edirlər: nəzarətsiz yayılan süni intellekt formaları gələcəkdə idarə olunması çox çətin texnoloji risklər doğura bilər.

S.ELAY

XQ